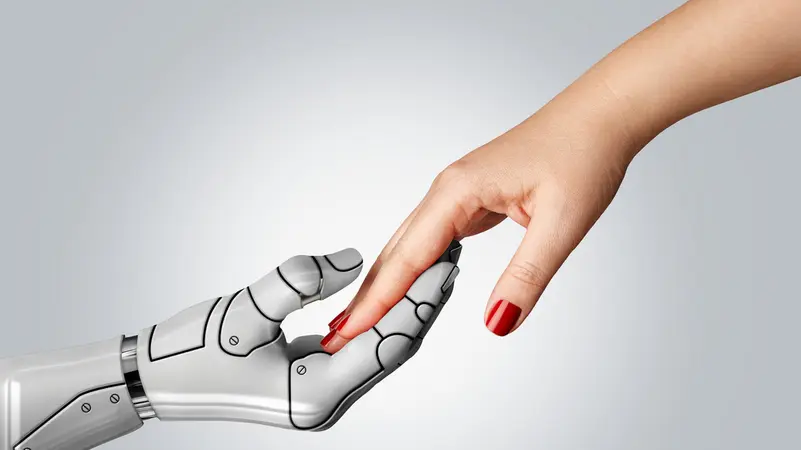

تبدي شركة “أوبن إيه آي”، المطورة لنموذج “تشات جي بي تي”، قلقها من إمكان أن تتسبب الواقعية الكبيرة في الصوت المرفق ببرنامجها للذكاء الاصطناعي في تعلّق المستخدمين بالتفاعلات الآلية على حساب العلاقات البشرية.

وأشارت الشركة، التي تتخذ مقراً في سان فرانسيسكو، في تقرير إلى أن الدردشة مع الذكاء الاصطناعي كما قد يفعل المرء مع شخص آخر قد تدفع بالمستخدمين إلى أن يضعوا ثقة في غير محلها بالبرامج الآلية، كما أن الجودة العالية للصوت المدمج بنسخة “جي بي تي- 4 أو” (GPT-4o) من “تشات جي بي تي” قد تفاقم هذا التأثير.

وقالت “أوبن إيه آي”، في التقرير عن العمل الأمني الذي تقوم به على نسخة ChatGPT-4o من برنامج الذكاء الاصطناعي الخاص بها، إن تقنيات التشبيه بالإنسان Anthropomorphization “نتضمن إسناد سلوكيات وخصائص خاصة بالبشر إلى كيانات غير بشرية، مثل نماذج الذكاء الاصطناعي”.

وحذّرت من أن “هذا الخطر قد يزداد بسبب القدرات الصوتية لـGPT-4o، والتي تسهّل المزيد من التفاعلات الشبيهة بالإنسان مع البرنامج” الآلي.

وقالت شركة “أوبن إيه آي” إنها لاحظت أن المستخدمين يتحدثون إلى الذكاء الاصطناعي بطرق تشير إلى روابط مشتركة، مثل التذمر بصوت عالٍ أمام البرنامج الآلي.

ولفتت إلى أن هذه الحالات تبدو حميدة، ولكن يتعيّن دراستها لمعرفة كيفية تطورها على مدى فترات أطول من الزمن.

وتكهنت “أوبن إيه آي” بأن التفاعل الاجتماعي مع الذكاء الاصطناعي قد يجعل المستخدمين أقل مهارة أو ميلاً للتواصل مع البشر.

وأشار التقرير إلى أن “التفاعل الموسّع مع البرنامج قد يؤثر على المعايير الاجتماعية”، مضيفاً “على سبيل المثال، نماذجنا تتعامل بتواضع مع المستخدمين وهذا يسمح لهم بالمقاطعة وأخذ الدور في الكلام في أي وقت، وهذا يتعارض مع آداب الحديث في التفاعلات البشرية، في حين أنه متوقع مع الذكاء الاصطناعي”.

وبحسب “أوبن إيه آي”، فإن قدرة الذكاء الاصطناعي على تذكّر التفاصيل أثناء المحادثة وإنجاز المهام قد تجعل الناس يعتمدون بشكل مفرط على التكنولوجيا.